Les promesses de l’informatique quantique ne se limitent plus aux laboratoires universitaires. Désormais, des feuilles de route industrielles, des plateformes cloud et des partenariats sectoriels dessinent une trajectoire plus lisible, même si la ligne d’arrivée reste mouvante. Dans cette course, Google et IBM se distinguent par l’ampleur de leur investissement et par la cohérence de leurs paris techniques. D’un côté, l’ambition de démonstrations spectaculaires et de percées sur la correction d’erreurs. De l’autre, une stratégie d’écosystème et d’accès commercial déjà structuré, pensée pour attirer développeurs, chercheurs et industriels. Entre les deux, une même réalité: sans progrès rapides sur les qubits, la stabilité et les coûts d’exploitation, l’ordinateur quantique restera un outil rare, réservé à quelques usages exploratoires.

Pourquoi, alors, engager des milliards sur une technologie qui semble encore fragile? Parce que le calcul quantique promet des ruptures sur des problèmes que les supercalculateurs classiques n’absorbent pas, ou trop lentement. Et parce qu’un avantage, même temporaire, peut rebattre les cartes dans la chimie, la logistique, la finance, ou la cybersécurité. Le sujet n’est donc pas une simple bataille de communication. Il s’agit d’un pari structurant sur la prochaine couche de puissance de calcul, avec un enjeu de souveraineté, de standards, et d’innovation industrielle.

- IBM pousse une approche modulaire et un écosystème ouvert via ses services d’accès au quantique.

- Google reste focalisé sur des avancées expérimentales et la fiabilité, héritées de la dynamique “supériorité quantique”.

- La correction d’erreurs et la qualité des qubits deviennent le nerf de la guerre, plus que le simple comptage.

- Les premiers secteurs ciblés: chimie, matériaux, optimisation, et modélisation financière.

- La sécurité accélère la migration vers des standards post-quantiques, avant même l’arrivée d’une machine “cryptographiquement décisive”.

Informatique quantique : pourquoi les milliards suivent enfin la recherche fondamentale

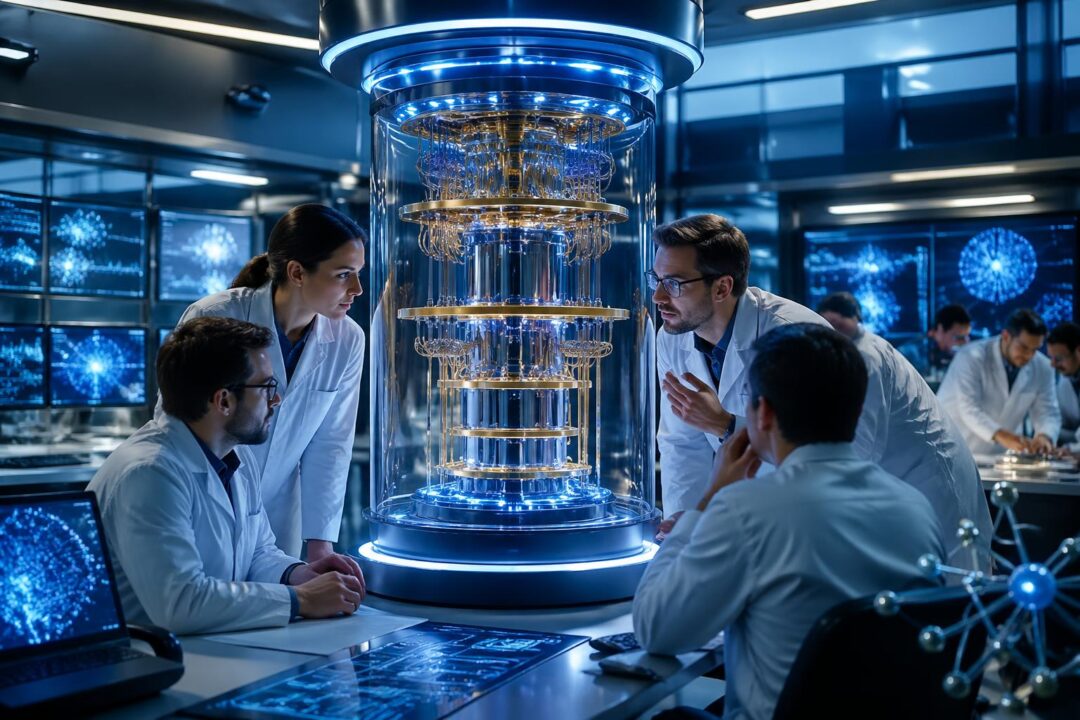

Le passage de la recherche fondamentale au produit industriel suit rarement une ligne droite. Pourtant, l’informatique quantique franchit un seuil: les grandes entreprises ne financent plus seulement des équipes académiques, elles financent des usines, des chaînes d’outillage et des plateformes logicielles. En clair, l’argent ne sert pas qu’à publier. Il sert à répéter, industrialiser et maintenir des systèmes qui fonctionnent à des températures extrêmes, avec une précision quasi chirurgicale.

Dans les faits, le calcul quantique vise une catégorie de problèmes où les approches classiques explosent en complexité. La simulation de molécules en chimie en est l’exemple le plus cité, parce qu’elle colle naturellement à la mécanique quantique. Toutefois, l’optimisation combinatoire attire aussi, car elle touche des secteurs concrets: itinéraires de livraison, allocation de ressources, planification d’usines. Ainsi, un investissement massif n’est pas motivé par une seule application. Il est motivé par un portefeuille d’usages, dont certains pourraient devenir dominants.

Pour saisir la logique économique, imaginons un fil conducteur: une entreprise fictive, HexaPharm, qui développe de nouveaux catalyseurs pour réduire les coûts de synthèse. Avec du calcul classique, HexaPharm doit choisir entre précision et délais. En revanche, même un gain partiel sur la simulation quantique peut réduire des mois d’essais. Or, si l’avantage arrive avant les concurrents, la rentabilité devient énorme. C’est ce type de scénario, répété dans plusieurs industries, qui justifie des budgets “hors normes”.

Des qubits au produit: une chaîne industrielle complète à financer

Un ordinateur quantique n’est pas un serveur “un peu spécial”. Il faut des réfrigérateurs à dilution, des électroniques de contrôle, des logiciels de compilation, et des équipes capables de diagnostiquer le bruit. Donc, chaque progrès sur les qubits entraîne un besoin d’infrastructure, puis de maintenance. Ensuite, il faut des outils pour que des non-physiciens puissent tester des algorithmes. C’est là que les géants entrent en scène, car ils savent construire des plateformes et attirer des communautés.

Cette dynamique explique aussi pourquoi les calendriers sont agressifs. Plus le temps passe, plus la fenêtre d’avantage se referme, car les standards se fixent et les compétences se diffusent. Par conséquent, la bataille se joue autant sur la vitesse d’itération que sur la découverte scientifique. À la fin, l’équipe qui transforme un prototype en service fiable gagne un pouvoir de marché, même si la machine n’est pas encore “révolutionnaire”.

Cette bascule vers l’industrialisation amène naturellement une question: comment IBM structure-t-il sa trajectoire, et pourquoi son approche séduit autant d’acteurs? C’est l’étape suivante.

IBM et l’ordinateur quantique industriel : roadmap ouverte, modules supraconducteurs et accès cloud

La stratégie d’IBM repose sur une idée simple: faire du quantique une plateforme, pas un trophée. Ainsi, l’entreprise met en avant une feuille de route où l’évolutivité compte autant que la performance brute. En parallèle, l’accès via le cloud a permis à des universités, des start-up et des grands groupes d’expérimenter sans acheter de matériel. Résultat: l’écosystème s’élargit, et les usages se testent plus tôt.

Dans ce modèle, l’investissement sert aussi à réduire le risque perçu par les industriels. Quand un acteur peut lancer un pilote, mesurer des limites, puis itérer, la décision budgétaire devient moins spéculative. De plus, une plateforme stable crée des effets d’apprentissage: les développeurs s’habituent à des outils, les chercheurs publient, et les partenaires construisent des briques métiers. Autrement dit, l’écosystème devient un actif, au même titre que les puces.

Choix techniques: qubits supraconducteurs et modularité

Sur le plan matériel, IBM privilégie des qubits supraconducteurs, qui nécessitent un refroidissement cryogénique très poussé. Ce choix n’est pas neutre, car il impose des contraintes d’ingénierie, mais il offre une voie d’intégration compatible avec des procédés industriels. Ensuite, l’approche modulaire vise à assembler des sous-systèmes plutôt que de construire un monolithe ingérable. Cette logique rappelle l’histoire des datacenters: l’échelle vient souvent de la répétition maîtrisée.

Le point dur reste la réduction des erreurs. Chaque opération quantique doit rester fidèle, sinon l’avantage s’effondre. Par conséquent, l’effort porte sur la qualité des portes logiques, la stabilité au fil du temps, et l’électronique de contrôle. Là, la recherche fondamentale rejoint l’ingénierie, car comprendre le bruit aide à le combattre. Et plus la correction d’erreurs progresse, plus les cas d’usage deviennent crédibles.

Cas d’usage ciblés: optimisation, matériaux, chimie quantique

Du côté applicatif, IBM cible des domaines où le retour sur investissement peut être mesuré. L’optimisation logistique, par exemple, promet de réduire des coûts en transport ou en stockage. La simulation de matériaux vise, elle, des innovations en batteries ou en semi-conducteurs. Quant à la chimie quantique, elle attire la pharmacie et l’énergie, car elle touche la conception moléculaire. Ainsi, l’objectif n’est pas de “tout accélérer”, mais de choisir des verticales.

Un pilote typique ressemble à ceci: une équipe métier formule un problème, des spécialistes le traduisent en algorithme hybride, puis la performance est comparée à des heuristiques classiques. Certes, les gains ne sont pas toujours au rendez-vous. Toutefois, chaque essai enrichit la compréhension des limites, et donc la feuille de route. Comme l’a résumé une participante à un projet pilote, un prototype a déjà pu réduire de façon notable le temps de certaines simulations, même si la généralisation reste exigeante.

| Acteur | Approche | Objectif principal | Accès / plateforme |

|---|---|---|---|

| IBM | Modules supraconducteurs, roadmap ouverte | Évolutivité industrielle | IBM Quantum Experience |

| Processeurs supraconducteurs, focus expérimental | Démonstrations de capacité et progrès sur l’erreur | Sycamore (recherche) | |

| Start-up | Technologies variées, parfois hybrides | Cas d’usage ciblés | Accès partenaire ou restreint |

| Instituts publics | Validation, standards, science ouverte | Fiabilité et méthodes | Publications scientifiques |

Cette approche “plateforme” éclaire le paysage, mais elle ne résume pas la course. Car l’autre moteur, plus spectaculaire, vient des démonstrations expérimentales et des paris sur la supériorité. C’est précisément le terrain de Google.

Google et le calcul quantique : de Sycamore à la bataille de la correction d’erreurs

Chez Google, l’histoire récente du quantique reste marquée par la démonstration de 2019 autour de Sycamore, souvent associée à l’idée de “supériorité quantique”. L’exercice portait sur une tâche spécifique, construite pour mettre en évidence un écart avec le calcul classique de l’époque. Depuis, l’enjeu a changé: prouver une performance utile, répétable, et surtout extensible. Autrement dit, il ne suffit plus d’être “premier sur un test”. Il faut devenir fiable sur des charges de travail d’intérêt.

Ce glissement explique pourquoi l’investissement reste massif. Améliorer un système quantique ne se résume pas à ajouter des qubits. Il faut aussi améliorer la calibration, réduire le bruit, et automatiser des routines de contrôle. Ensuite, il faut intégrer des techniques de correction d’erreurs, car les gains d’échelle sans protection se traduisent souvent par plus d’instabilité. Ainsi, la valeur se déplace de la démonstration isolée vers l’ingénierie d’endurance.

Ce que “supériorité” a vraiment déclenché dans l’écosystème

L’épisode Sycamore a déclenché une accélération, parce qu’il a rendu le sujet tangible pour des décideurs. En conséquence, des budgets se sont débloqués, et des programmes publics se sont renforcés. Par ailleurs, la concurrence s’est durcie autour des architectures. Supraconducteur, ions piégés, photons, atomes neutres: chaque approche revendique une route vers l’échelle. Or, la diversité technologique fait monter les enchères, car personne ne veut rater le “bon cheval”.

Dans les laboratoires, la méthodologie est devenue centrale. Avant chaque exécution, une calibration fine s’impose, sinon les résultats dérivent. Ensuite, des métriques de fidélité mesurent la qualité des opérations. Enfin, la validation passe par comparaison avec des méthodes classiques et par revue par les pairs. Cette discipline renforce la crédibilité, même quand les annonces sont débattues. Et c’est sain, car la science a besoin de réplicabilité pour avancer vite.

Les limites qui rendent la fiabilité décisive

Les obstacles sont bien identifiés: décohérence, bruit, erreurs de lecture, couplages indésirables. Dès lors, le défi ressemble à un combat contre l’entropie. Chaque amélioration matérielle doit s’accompagner d’améliorations logicielles, sinon l’utilisateur ne gagne rien. C’est pourquoi les architectures de correction d’erreurs attirent autant d’attention: elles promettent une stabilité “systémique”, et pas seulement un exploit ponctuel.

Un point retient particulièrement l’attention en 2026: certains travaux montrent qu’une meilleure correction peut réduire le besoin en qubits physiques pour atteindre un niveau logique exploitable. Dit autrement, la performance ne vient pas que du nombre. Elle vient de la qualité et de l’organisation. Cela rejoint une intuition d’ingénieur: un système robuste vaut mieux qu’un système gigantesque mais capricieux. La suite logique, alors, est d’évaluer où cette robustesse change vraiment la donne: la sécurité et la cryptographie.

La rivalité technologique ne se joue pas en vase clos, car une percée quantique a un effet immédiat sur les stratégies de cybersécurité. C’est le prochain front, et il mobilise autant les États que les entreprises.

Cryptographie post-quantique : pourquoi la sécurité accélère les investissements de Google et IBM

La sécurité est l’argument le plus concret pour convaincre des comités de direction. En effet, un ordinateur quantique suffisamment puissant pourrait fragiliser des schémas cryptographiques largement déployés, notamment ceux qui protègent échanges et signatures. Même si cette échéance n’est pas immédiate, le temps de migration est long. Par conséquent, la préparation commence avant la “machine décisive”, car l’inertie des infrastructures est énorme.

Cette pression sécuritaire nourrit l’investissement de deux façons. D’abord, elle finance la recherche sur les algorithmes post-quantiques, qui doivent rester efficaces sur les systèmes actuels. Ensuite, elle soutient l’expérimentation de la cryptographie quantique pour certains liens sensibles, par exemple via distribution de clés. Dans les deux cas, la promesse est claire: réduire le risque futur, tout en structurant un marché de produits et de services.

Migration post-quantique: un chantier opérationnel, pas un slogan

Pour une banque, le sujet n’est pas théorique. Les certificats, les HSM, les protocoles réseau, et les dépendances logicielles forment un millefeuille. Donc, changer d’algorithme impose des audits, des tests de compatibilité, puis des déploiements progressifs. De même, les administrations doivent protéger des communications qui peuvent être stockées aujourd’hui et déchiffrées demain. C’est le scénario “harvest now, decrypt later”, qui justifie l’anticipation.

Dans ce contexte, Google et IBM jouent un rôle indirect mais structurant. Leurs travaux sur le calcul quantique rendent la menace plus crédible, donc les budgets de migration augmentent. En parallèle, leurs offres cloud et leurs partenariats aident à tester des solutions hybrides, mêlant standards classiques renforcés et briques post-quantiques. Ainsi, la sécurité devient un moteur d’adoption, même si la performance quantique “utile” reste en construction.

Qui risque quoi, et avec quelles réponses

La cartographie des risques varie selon les secteurs, car les données n’ont pas la même durée de vie. Une donnée médicale peut rester sensible des décennies. Une clé de signature logicielle, elle, peut compromettre une chaîne d’approvisionnement entière. D’où un mouvement vers des stratégies de transition: double chiffrement, renouvellement accéléré des clés, et inventaire des dépendances. Comme l’observent plusieurs responsables sécurité côté industrie, les feuilles de route intègrent déjà la contrainte post-quantique, car personne ne veut réagir dans l’urgence.

| Domaine | Risque principal | Réponse technologique | Acteurs |

|---|---|---|---|

| Banque | Exposition des clés et signatures | Migration post-quantique, inventaire cryptographique | Institutions financières, fintech |

| Gouvernement | Compromission de communications sensibles | Algorithmes post-quantiques, gestion renforcée des clés | Agences publiques, défense |

| Industrie | Vol de propriété intellectuelle | Protection hybride, segmentation, durcissement | Groupes technologiques, supply chain |

| Santé | Données patients à longue durée de vie | Adoption progressive de normes, chiffrement renforcé | Hôpitaux, éditeurs, assureurs |

La sécurité met la pression, mais l’argent ne suit durablement que si des marchés se dessinent. Il faut donc examiner les usages “business” attendus, et la manière dont ils structurent la compétition mondiale.

Au-delà de la cybersécurité, la bataille se déplace vers les applications industrielles où un avantage, même modeste, peut se monnayer rapidement.

Applications et marchés du quantique : chimie, logistique, finance et l’effet plateforme

Les cas d’usage du quantique sont souvent présentés comme futuristes. Pourtant, les entreprises les plus avancées parlent désormais de pilotes, de métriques et de retours d’expérience. Cela change tout, car un marché naît quand une organisation peut budgéter un test, comparer des résultats, puis décider. Dans cette logique, IBM valorise l’accès et l’outillage, tandis que Google pousse la frontière technologique. Les deux stratégies peuvent converger, car la valeur finale dépendra autant de la machine que de l’écosystème logiciel.

Un point clé est l’hybridation. Dans la plupart des scénarios, un algorithme quantique ne remplace pas un datacenter. Il s’imbrique dans une chaîne classique, avec prétraitement, exécution quantique, puis post-traitement. Ainsi, les compétences cloud, MLOps et data engineering deviennent pertinentes. Par conséquent, les géants du numérique disposent d’un avantage: ils maîtrisent déjà la mise en production de systèmes complexes. Le quantique s’ajoute comme un accélérateur potentiel, pas comme un monde séparé.

Chimie et matériaux: l’exemple qui parle aux industriels

La chimie quantique reste la “killer app” la plus intuitive, car elle épouse la physique sous-jacente. Par exemple, un industriel des matériaux veut comprendre une réaction ou stabiliser une structure cristalline. Avec des méthodes classiques, il existe des approximations, mais elles plafonnent sur certains systèmes. Or, un calcul quantique plus précis peut réduire les cycles d’essais. Ensuite, un meilleur matériau peut se traduire par une batterie plus durable, ou un catalyseur plus efficace. Voilà pourquoi l’investissement suit: le gain économique potentiel est énorme.

Reprenons le fil d’HexaPharm. L’entreprise ne cherche pas une “révolution” immédiate. Elle cherche un outil qui améliore un sous-problème, comme l’évaluation d’états électroniques sur une famille de molécules. Même un gain partiel peut orienter les choix expérimentaux. Et quand une décision de laboratoire coûte cher, une meilleure direction vaut de l’or. Cette logique incrémentale rend l’adoption plus réaliste.

Optimisation logistique: quand le quantique rencontre le terrain

La logistique offre un terrain pragmatique, car les objectifs sont clairs: réduire kilomètres, énergie, et retards. Toutefois, les données sont bruyantes, et les contraintes changent en temps réel. Donc, un algorithme quantique doit être robuste, sinon il devient inutilisable. C’est ici que les approches hybrides dominent: le quantique peut explorer certaines configurations, pendant que le classique gère la stabilité et les mises à jour. Ainsi, le quantique peut devenir une brique, pas une solution totale.

Dans les appels d’offres, un point revient: la capacité à intégrer l’outil aux systèmes existants. C’est une question de connecteurs, de SLA, et de gouvernance des données. Là encore, le modèle plateforme pèse lourd. Une solution sans intégration reste un démonstrateur. À l’inverse, une solution intégrable devient un produit.

Finance et modélisation: prudence, mais intérêt réel

La finance s’intéresse au quantique pour la modélisation de portefeuilles et certains calculs probabilistes. Cependant, les exigences de conformité et de traçabilité sont fortes. Donc, les pilotes avancent avec prudence, souvent en environnement contrôlé. En parallèle, les institutions investissent dans la sécurité post-quantique, car la protection des échanges est non négociable. Au final, la finance illustre bien le paradoxe: elle veut l’avantage de calcul, mais elle ne tolère pas l’opacité.

Ce panorama des usages débouche sur une dernière question: comment évaluer, sans fantasme, la trajectoire réelle vers un quantique “commercialement pertinent”? La réponse passe par des critères concrets, et par une lecture lucide des annonces.

Mesurer les progrès en informatique quantique : au-delà du nombre de qubits, les critères qui comptent

Le nombre de qubits fait un bon titre. Pourtant, il ne suffit plus pour juger un système. En pratique, les décideurs regardent la qualité des opérations, la stabilité dans le temps, et la capacité à exécuter des circuits plus profonds. En d’autres termes, un système plus petit mais plus fiable peut battre un système plus grand et instable. Cette réalité force Google et IBM à communiquer différemment: moins sur le spectaculaire, plus sur les métriques d’ingénierie.

Pour les industriels, trois questions dominent. D’abord, quel est le coût d’accès et d’exploitation? Ensuite, combien de temps faut-il pour obtenir un résultat reproductible? Enfin, peut-on intégrer le quantique dans une chaîne logicielle existante? Ces questions ramènent le sujet au terrain. Et c’est précisément ce qui motive l’investissement: transformer une prouesse fragile en service utilisable.

Des indicateurs plus parlants que les annonces

Les spécialistes scrutent la fidélité des portes, les taux d’erreur de lecture, et la capacité à exécuter des circuits plus longs. Ils regardent aussi la correction d’erreurs, car elle conditionne l’échelle. De plus, ils évaluent l’automatisation de la calibration, car un système qui exige une intervention constante ne passera pas à l’industrialisation. Ainsi, l’innovation ne se niche pas que dans la puce. Elle se niche aussi dans l’outillage et le logiciel.

Dans ce cadre, la compétition se déplace vers un triptyque: matériel, contrôle, et stack logiciel. IBM capitalise sur un accès large, qui multiplie les retours d’expérience. Google pousse des méthodes de réduction d’erreurs et des avancées expérimentales. Entre les deux, les start-up explorent d’autres voies, comme les atomes neutres ou les photons, afin de trouver un chemin plus direct vers l’échelle. Cette diversité rend le marché vivant, mais elle rend aussi les comparaisons difficiles.

Pourquoi les États et les standards comptent autant

Les investissements publics jouent un rôle d’accélérateur, car ils financent la formation, les infrastructures et des programmes long terme. En parallèle, les standards deviennent essentiels, notamment pour la sécurité et l’interopérabilité. Sans standards, chaque projet devient un silo. Avec des standards, une chaîne de valeur émerge. C’est pourquoi la normalisation post-quantique mobilise autant: elle prépare le terrain, même si la machine “ultime” n’est pas encore là.

Au fond, l’informatique quantique progresse par étapes mesurables. Et c’est cette progressivité, parfois frustrante, qui rend la course crédible. Reste à trancher une question de fond: s’agit-il d’une bulle ou d’une transformation durable? L’avis se joue sur la qualité des preuves et sur la discipline des acteurs.

On en dit quoi ?

Le pari de Google et IBM ressemble moins à une ruée irrationnelle qu’à une stratégie de long terme, structurée autour d’une idée: le calcul quantique peut créer des avantages sectoriels, même avant l’ordinateur universel rêvé. Cependant, l’histoire récente rappelle qu’un prototype ne fait pas un produit, et que la correction d’erreurs décidera du calendrier réel. En attendant, l’impact le plus immédiat est déjà là: la cybersécurité et les standards post-quantiques avancent, car personne ne veut subir le futur.

Pourquoi Google et IBM investissent-ils autant dans l’informatique quantique ?

Parce que l’informatique quantique promet des gains sur des problèmes difficiles pour le calcul classique, et parce qu’un avantage même partiel peut générer un effet compétitif en chimie, optimisation ou sécurité. L’investissement finance autant la recherche fondamentale que l’industrialisation (matériel cryogénique, contrôle, logiciels, plateformes cloud).

Le nombre de qubits suffit-il à comparer deux ordinateurs quantiques ?

Non. Le nombre de qubits est un indicateur incomplet. Les métriques décisives incluent la fidélité des opérations, les taux d’erreur, la stabilité, la profondeur de circuits supportée et les mécanismes de correction d’erreurs. Un système plus petit mais plus fiable peut être plus utile.

À quoi sert IBM Quantum Experience dans la stratégie d’IBM ?

Cette plateforme donne un accès à des machines quantiques via le cloud et permet de tester des algorithmes, de former des équipes et de prototyper des cas d’usage. Elle aide IBM à créer un écosystème et à accélérer l’adoption, ce qui renforce la valeur de sa roadmap industrielle.

La cryptographie actuelle est-elle déjà menacée par un ordinateur quantique ?

La menace n’est pas immédiate pour la plupart des systèmes, mais la transition est longue. Le risque principal tient au stockage de données chiffrées aujourd’hui pour un déchiffrement futur. D’où l’accélération de la migration vers des algorithmes post-quantiques et des stratégies de gestion de clés.

Quels secteurs pourraient bénéficier en premier du calcul quantique ?

Les candidats les plus cités sont la chimie et les matériaux (simulation), l’optimisation (logistique, planification) et certains besoins de modélisation en finance. Dans beaucoup de cas, les approches hybrides, combinant classique et quantique, devraient arriver avant des gains pleinement “universels”.

Journaliste tech passionné de 38 ans, je décrypte chaque jour l’actualité numérique et j’adore rendre la technologie accessible à tous.